Ar tikrai galime pasitikėti viskuo, ką skaitome internete? Kasdien mus supa informacijos srautai, kuriais lengva manipuliuoti – formuoti mūsų nuomonę, daryti įtaką sprendimams, net keisti elgesį. Propaganda ir dezinformacija tampa galingais įrankiais, ypač kai jie pasitelkiami informaciniuose karuose. Ar galime su tuo kovoti?

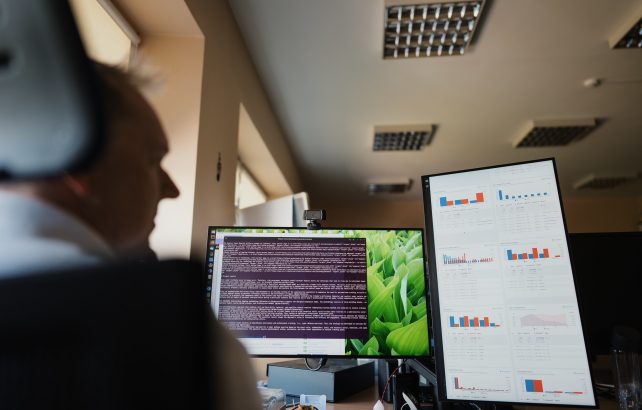

Vilniaus universiteto (VU) Matematikos ir informatikos fakulteto mokslininkai teigia, kad taip. Jų kuriamas projektas ATSPARA siekia panaudoti dirbtinį intelektą ir hibridinius neuroninius tinklus, kad greitai ir efektyviai atpažintų propagandinių ir dezinformacinių pranešimų srautus lietuvių kalba ir taip padėtų žmonėms ir suinteresuotoms institucijoms laiku užkardyti šio srauto plitimą bei poveikį.

„Dirbtinis intelektas tampa galingu įrankiu, kuris gali greitai ir tiksliai įvertinti informacijos patikimumą ir aptikti subtilius propagandos elementus. Tai leis ne tik žurnalistams ar medijų kompanijoms, bet ir plačiajai visuomenei apsisaugoti nuo klaidinančios informacijos poveikio“, – sako projekto vadovas prof. Darius Plikynas. Projekto ATSPARA tikslas – sukurti pažangų sprendimų paramos įrankį, padedantį efektyviai aptikti propagandą ir dezinformaciją naujienų portaluose ir socialinių tinklų pranešimuose.

Kokios grėsmės kyla Lietuvos informacinėje erdvėje?

„Kalbant apie šį tyrimą, svarbu pabrėžti, kad propaganda ir dezinformacija, nors iš dalies ir sutampa, nėra tapatūs reiškiniai. Propaganda, priešingai nei dezinformacija, gali pasireikšti ir teisinguose, ir klaidinguose teiginiuose, o jos tikslai gali būti arba žalingi, arba nekenksmingi (netgi geri). Propaganda nebūtinai turi meluoti – ji gali tiesiog apeliuoti į emocijas arba pateikti selektyviai atrinktus faktus. Tuo tarpu dezinformacija visada yra klaidinga ar netiksli informacija, sąmoningai sukurta ir skleidžiama norint suklaidinti. Ji informacinio karo kontekste tikslingai naudojama siekiant sukelti visuomenės cinizmą, netikrumą, apatiją, nepasitikėjimą ir paranoją“, – apie tyrimo svarbą pasakoja pagrindinė projekto vykdytoja dr. Gražina Korvel.

Dr. Gražina Korvel

Dr. Gražina Korvel

Anot projekto vadovo prof. D. Plikyno, propaganda ir dezinformacija tampa vis didesniu iššūkiu Lietuvos informacinėje erdvėje, keliančiu grėsmę ne tik visuomenės pasitikėjimui žiniasklaida, bet ir šalies demokratiniams procesams. Masiškai skleidžiama klaidinanti informacija dažnai formuoja vadinamuosius „informacinius burbulus“, kuriuose žmonės gauna tik jų pažiūras patvirtinančią informaciją, ignoruodami priešingus faktus. Tai sukelia paradoksalius reiškinius – kaip antai, greta jau senokai stebimo visuomenių globalizacijos reiškinio kartu, tik mažesniu mastu, vyksta ir visuomenių idėjinės fragmentacijos reiškiniai, kurie veda į radikalėjimą ir poliariškumą.

Lietuvoje vis dažniau pasitelkiamos informacinės atakos, siekiant skleisti nepasitikėjimą valstybe, dezinformaciją apie svarbius politinius sprendimus ar net kelti abejones šalies užsienio politikos kryptimis. Šie išpuoliai dažnai yra subtilūs ir paslėpti, todėl jiems atpažinti reikia tiek visuomenės informacinio raštingumo, tiek pažangių technologinių sprendimų. Mašininio mokymosi algoritmai ir dirbtinio intelekto metodai gali būti efektyvus įrankis kovojant su dezinformacijos plitimu, leidžiantis greitai ir tiksliai identifikuoti melagingą informaciją ir neleisti jai paveikti visuomenės nuomonių ir elgesio.

Dirbtinio intelekto sprendimai propagandai atpažinti

Vienas iš svarbiausių projekto ATSPARA uždavinių yra sukurti propagandos ir dezinformacijos tekstyną lietuvių kalba ir pasitelkus mašininį mokymą – viešai prieinamą įrankį, kuris leistų medijų kompanijoms, portalams ar tiesiog žmonėms automatizuotai įvertinti straipsnių, naujienų pranešimų ar tiesiog tekstų propagandos ir dezinformacijos lygį, naudojamų propagandos technikų paplitimą, dezinformacinius naratyvus (temas) ir galimo socialinio poveikio rodiklius.

Projekte pasitelkiami hibridiniai gilūs neuroniniai tinklai, kurie mokomi remiantis ekspertų atliekama pranešimų turinio analize. Šio proceso metu sukuriamas specialus tekstynas, leidžiantis mašininio mokymosi algoritmams mokytis atpažinti įvairias propagandos technikas. Taip dirbtinis intelektas tampa galingu įrankiu, galinčiu analizuoti didelius informacijos kiekius, įvertinti pranešimų patikimumą ir automatiškai identifikuoti galimai žalingą turinį.

Propagandos ir dezinformacijos poveikis informacinio karo kontekste

Propagandos ir dezinformacijos poveikis smarkiai suintensyvėjo vykstant informaciniam karui, kai masiškai ir sistemingai naudojami medijų portalai, socialiniai tinklai bei botai. Tyrimai rodo, kad tokie srautai formuoja informacinius burbulus ir aido kameras, kurios indoktrinuoja, skaldo ir radikalizuoja visuomenę. Ypač tai skatina slapta organizuota trečiųjų šalių veikla, ardanti visuomenės sanglaudą.

„VU Matematikos ir informatikos fakulteto Duomenų mokslo ir skaitmeninių technologijų instituto doktorantei Ievai Rizgelienei prieš porą metų kilo idėja skirti savo disertaciją šiai temai. Kaip jos vadovas, palaikiau šią iniciatyvą ir ėmiausi organizuoti finansavimą projektui, kad būtų suburta daugiau patyrusių mokslininkų ir plėtojami tyrimai šia linkme“, – pasakoja prof. D. Plikynas.

Prof. D. Plikynas

Prof. D. Plikynas

Mokslininkas atskleidžia, kad iš pradžių net ir institute gan skeptiškai žiūrėta į tokio tyrimo idėją: „Matematikams ir informatikams kliuvo tyrimo objekto pavadinime esantis žodis „propaganda“, kuris yra sunkiai tiksliai apibrėžiamas ir subjektyviai vertinamas.“

Pasak projekto vadovo, tenka pralaužti ledus, kad ir instituto kolegos įžvelgtų naujas galimybes, kurias teikia sudėtingų socialinių reiškinių tyrimai mašininio mokymo metodais. Sisteminė pasaulyje atliekamų šios srities tyrimų apžvalga parodė, kad melagienos, propagandos ir dezinformacijos temų per pastarąjį dešimtmetį beveik eksponentiškai daugėja.

Į tyrimus įtraukiama ne tik pranešimų tekstų, bet ir garsinės bei vaizdinės analizės. Be to, modernūs propagandos ir dezinformacijos atpažinimo modeliai greta pranešimo turinio analizės apima ir šaltinių bei sklaidos botų tinklų veiklos, sklidimo socialiniuose tinkluose trajektorijų ir socialinio poveikio analizę.

„Visa tai padeda tiksliau ir greičiau aptikti propagandos bei dezinformacijos srautus ir laiku juos užkardyti, taip sumažinant neigiamą poveikį visuomenės sanglaudai“, – pasakoja projekto ATSPARA vadovas.

Šis įrankis veiks naudojant hibridinius neuroninius tinklus, kurie apdoroja didelius duomenų kiekius, mokydamiesi iš ekspertų atliekamų turinio analizės rezultatų. Mašininis mokymasis gali būti efektyvi priemonė, padedanti atpažinti melagingą turinį ir užkirsti kelią jo plitimui, taip sumažinant neigiamą poveikį visuomenės vertybėms ir politiniams procesams.

Finansavimą skyrė Lietuvos mokslo taryba (LMTLT), sutarties Nr. S-VIS-23-8, iš valstybės biudžeto lėšų pagal konkursinę prioritetinių mokslinių tyrimų programą „Visuomenės atsparumo stiprinimas ir krizių valdymas šiuolaikinių geopolitinių įvykių kontekste“.

Komentarų nėra. Būk pirmas!